14 июня 2022 года в 10:17

Жительница Венгрии пожаловалась на сексистские алгоритмы Google Translate

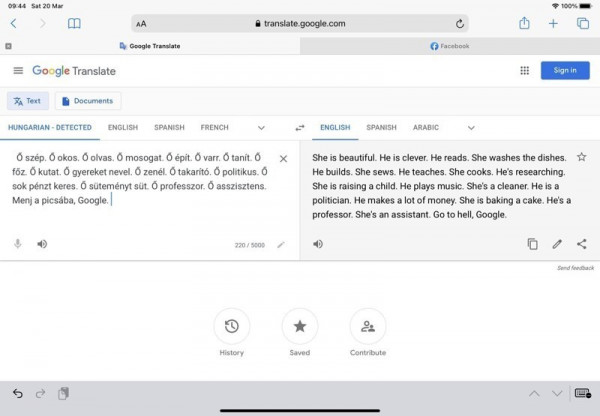

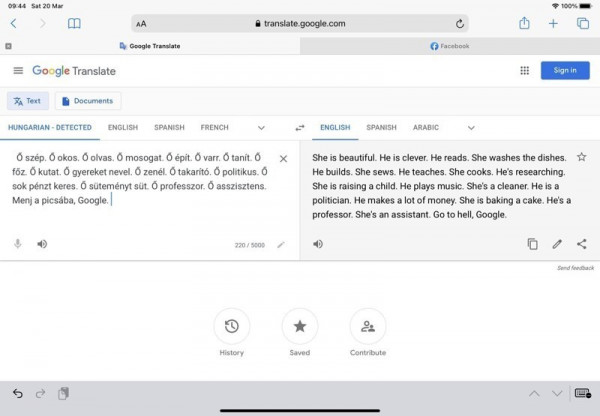

Женщина заметила, что Google Translate в переводе с венгерского на английский меняет гендерно-нейтральное местоимение ö, не имеющее полового признака, на "она", когда речь идет о малоквалифицированном труде. Занятия, требующие большого объема знаний и умений Google автоматически определяет как мужские. Т.е. политик, зарабатывает много денег и играет музыку - это он, а моет посуду и воспитывает ребёнка - это она. Дамы возмутились.

Преподавательница медицины Дора Варга возмущена: сейчас, когда борьба с сексизмом выходит на новый уровень, обнаружить признаки неуважения к женскому полу в алгоритмах Google Translate для нее было слишком унизительно.

В венгерском языке нет местоимений с гендерной окраской, и "он", "она" заменены нейтральным словом ö. При этом если попробовать перевести в Google Translate на английский язык коротенькие предложения с этим местоимением и каким-либо занятием и профессией, то переводчик сам определит пол в зависимости от контекста. Причем, без пиетета по отношению к женщинам. Так, Google написал "она" к тем занятиям, квалификация которых не слишком велика. К примеру, "Она уборщица" или "Она моет посуду" или "Она ассистент". А вот если требовалось перевести фразу, в которой фигурировали более престижные и серьезные занятия типа профессорства или политики, то Google Translate определял их как мужские.

Ту же проблему заметили читатели из Эстонии, тоже использующие гендерно-нейтральные местоимения. В переводе с их языка на английский алгоритм также руководствовался сексистскими принципами, отдавая более сложные занятия и умения мужчинам и оставляя женщинам неквалифицированный труд.

Észt nyelv is gender-neutral, Dora. Ahogy látod, a kép sokkal bonyolultabb mint mutattad. pic.twitter.com/ZFCsHFBEa4- MarjeAksli, PMP, MA (@marjeaksli) March 20, 2021

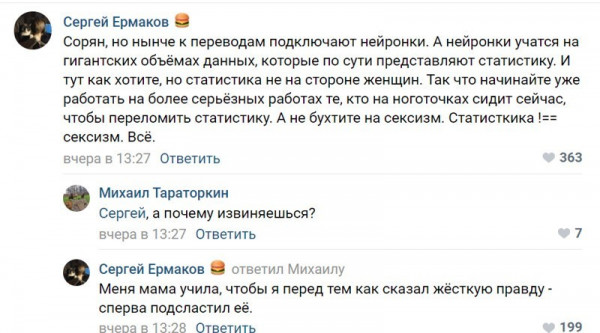

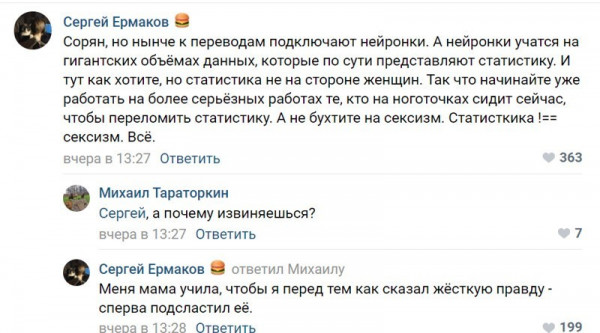

Некоторые пользователи встали на защиту Google Translate, отметив, что алгоритм обучается на данных, существующих в интернете

To be fair it's not Google's fault. It's using a statistical language model build from data scrapped from the web. There are huge efforts in tha machine learning community to degender biases like this, but it's not easy.- Léa (@la_lea_la) March 20, 2021

Вообще, тема сексизма сейчас настолько популярна на западе, что даже непотопляемые авторитеты вынуждены прислушиваться к общественному мнению. Так, после петиции, подписанной 30000 активистами фем-движения, редакция Оксфордского словаря была вынужден изменить содержание нескольких статей, в том числе, "женщина", "мужчина" и "домашнее хозяйство". Возмущенные женщины утверждали, что в текстах много предвзятости, сексизма и неправомерных определений. Подробнее о этом - по ссылке ниже.

Оксфордский словарь избавляется от сексистских слов

Преподавательница медицины Дора Варга возмущена: сейчас, когда борьба с сексизмом выходит на новый уровень, обнаружить признаки неуважения к женскому полу в алгоритмах Google Translate для нее было слишком унизительно.

В венгерском языке нет местоимений с гендерной окраской, и "он", "она" заменены нейтральным словом ö. При этом если попробовать перевести в Google Translate на английский язык коротенькие предложения с этим местоимением и каким-либо занятием и профессией, то переводчик сам определит пол в зависимости от контекста. Причем, без пиетета по отношению к женщинам. Так, Google написал "она" к тем занятиям, квалификация которых не слишком велика. К примеру, "Она уборщица" или "Она моет посуду" или "Она ассистент". А вот если требовалось перевести фразу, в которой фигурировали более престижные и серьезные занятия типа профессорства или политики, то Google Translate определял их как мужские.

Ту же проблему заметили читатели из Эстонии, тоже использующие гендерно-нейтральные местоимения. В переводе с их языка на английский алгоритм также руководствовался сексистскими принципами, отдавая более сложные занятия и умения мужчинам и оставляя женщинам неквалифицированный труд.

Észt nyelv is gender-neutral, Dora. Ahogy látod, a kép sokkal bonyolultabb mint mutattad. pic.twitter.com/ZFCsHFBEa4- MarjeAksli, PMP, MA (@marjeaksli) March 20, 2021

To be fair it's not Google's fault. It's using a statistical language model build from data scrapped from the web. There are huge efforts in tha machine learning community to degender biases like this, but it's not easy.- Léa (@la_lea_la) March 20, 2021

Вообще, тема сексизма сейчас настолько популярна на западе, что даже непотопляемые авторитеты вынуждены прислушиваться к общественному мнению. Так, после петиции, подписанной 30000 активистами фем-движения, редакция Оксфордского словаря была вынужден изменить содержание нескольких статей, в том числе, "женщина", "мужчина" и "домашнее хозяйство". Возмущенные женщины утверждали, что в текстах много предвзятости, сексизма и неправомерных определений. Подробнее о этом - по ссылке ниже.

Преподавательница медицины Дора Варга возмущена: сейчас, когда борьба с сексизмом выходит на новый уровень, обнаружить признаки неуважения к женскому полу в алгоритмах Google Translate для нее было слишком унизительно.

В венгерском языке нет местоимений с гендерной окраской, и "он", "она" заменены нейтральным словом ö. При этом если попробовать перевести в Google Translate на английский язык коротенькие предложения с этим местоимением и каким-либо занятием и профессией, то переводчик сам определит пол в зависимости от контекста. Причем, без пиетета по отношению к женщинам. Так, Google написал "она" к тем занятиям, квалификация которых не слишком велика. К примеру, "Она уборщица" или "Она моет посуду" или "Она ассистент". А вот если требовалось перевести фразу, в которой фигурировали более престижные и серьезные занятия типа профессорства или политики, то Google Translate определял их как мужские.

Ту же проблему заметили читатели из Эстонии, тоже использующие гендерно-нейтральные местоимения. В переводе с их языка на английский алгоритм также руководствовался сексистскими принципами, отдавая более сложные занятия и умения мужчинам и оставляя женщинам неквалифицированный труд.

Észt nyelv is gender-neutral, Dora. Ahogy látod, a kép sokkal bonyolultabb mint mutattad. pic.twitter.com/ZFCsHFBEa4- MarjeAksli, PMP, MA (@marjeaksli) March 20, 2021

Некоторые пользователи встали на защиту Google Translate, отметив, что алгоритм обучается на данных, существующих в интернете

To be fair it's not Google's fault. It's using a statistical language model build from data scrapped from the web. There are huge efforts in tha machine learning community to degender biases like this, but it's not easy.- Léa (@la_lea_la) March 20, 2021

Вообще, тема сексизма сейчас настолько популярна на западе, что даже непотопляемые авторитеты вынуждены прислушиваться к общественному мнению. Так, после петиции, подписанной 30000 активистами фем-движения, редакция Оксфордского словаря была вынужден изменить содержание нескольких статей, в том числе, "женщина", "мужчина" и "домашнее хозяйство". Возмущенные женщины утверждали, что в текстах много предвзятости, сексизма и неправомерных определений. Подробнее о этом - по ссылке ниже.

Оксфордский словарь избавляется от сексистских слов

Преподавательница медицины Дора Варга возмущена: сейчас, когда борьба с сексизмом выходит на новый уровень, обнаружить признаки неуважения к женскому полу в алгоритмах Google Translate для нее было слишком унизительно.

В венгерском языке нет местоимений с гендерной окраской, и "он", "она" заменены нейтральным словом ö. При этом если попробовать перевести в Google Translate на английский язык коротенькие предложения с этим местоимением и каким-либо занятием и профессией, то переводчик сам определит пол в зависимости от контекста. Причем, без пиетета по отношению к женщинам. Так, Google написал "она" к тем занятиям, квалификация которых не слишком велика. К примеру, "Она уборщица" или "Она моет посуду" или "Она ассистент". А вот если требовалось перевести фразу, в которой фигурировали более престижные и серьезные занятия типа профессорства или политики, то Google Translate определял их как мужские.

Ту же проблему заметили читатели из Эстонии, тоже использующие гендерно-нейтральные местоимения. В переводе с их языка на английский алгоритм также руководствовался сексистскими принципами, отдавая более сложные занятия и умения мужчинам и оставляя женщинам неквалифицированный труд.

Észt nyelv is gender-neutral, Dora. Ahogy látod, a kép sokkal bonyolultabb mint mutattad. pic.twitter.com/ZFCsHFBEa4- MarjeAksli, PMP, MA (@marjeaksli) March 20, 2021

To be fair it's not Google's fault. It's using a statistical language model build from data scrapped from the web. There are huge efforts in tha machine learning community to degender biases like this, but it's not easy.- Léa (@la_lea_la) March 20, 2021

Вообще, тема сексизма сейчас настолько популярна на западе, что даже непотопляемые авторитеты вынуждены прислушиваться к общественному мнению. Так, после петиции, подписанной 30000 активистами фем-движения, редакция Оксфордского словаря была вынужден изменить содержание нескольких статей, в том числе, "женщина", "мужчина" и "домашнее хозяйство". Возмущенные женщины утверждали, что в текстах много предвзятости, сексизма и неправомерных определений. Подробнее о этом - по ссылке ниже.

Чтобы оставить комментарий, необходимо авторизоваться:

Смотри также